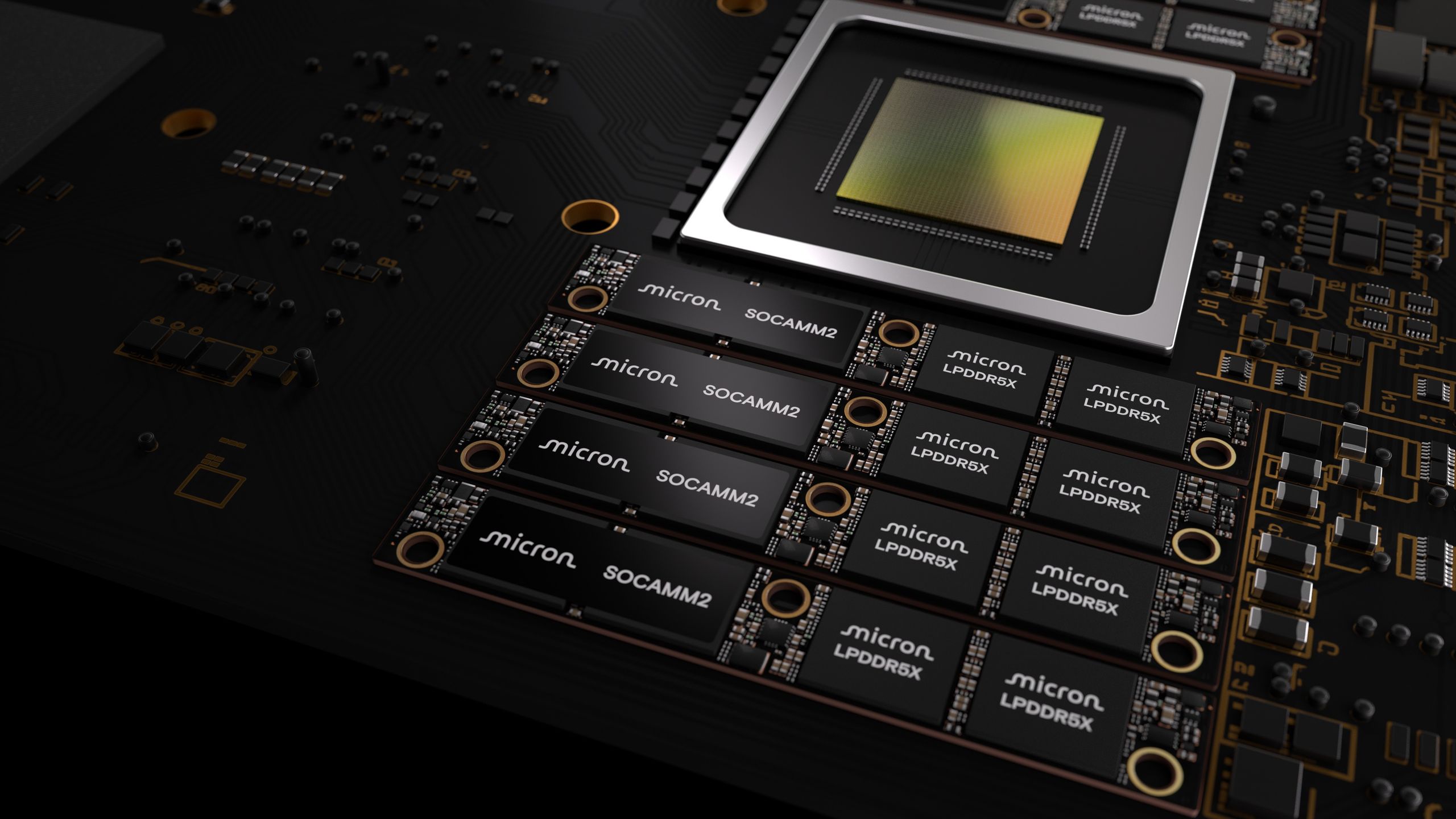

Micron, 256GB tutumlu SOCAMM2 yaddaş modulu təqdim edib. Bu modul, 64 ədəd 32GB LPDDR5x çipdən ibarətdir və əsasən AI serverlərində istifadə üçün nəzərdə tutulub. Hətta 8 SOCAMM2 modulunu bir serverə yerləşdirərək toplam 2TB yaddaş tutumuna çatmaq mümkündür. Bu, xüsusilə böyük dil modelləri və müasir təsvir boru xətləri üçün böyük yaddaş hovuzları tələb edən AI iş yükləri üçün çox əhəmiyyətlidir.

Micron-un bu yeni modulu, məlumat mərkəzlərində sistem yaddaşına olan tələbatı qarşılamaq üçün hazırlanmışdır. Modulun sıx LPDRAM paketi, müasir AI iş yüklərinin artan yaddaş ehtiyaclarını qarşılamaq üçün idealdır. 8 kanal server CPU-da 8 SOCAMM2 modul quraşdırıldıqda, toplam 2TB LPDRAM tutumuna nail olunur. Bu, əvvəlki 192GB modullardan təxminən üçdə bir daha çoxdur.

Micron, SOCAMM2 dizaynının ənənəvi server yaddaş modullarına nisbətən daha səmərəli olduğunu bildirir. Micron-un Cloud Memory Business Unit-in baş vitse-prezidenti Raj Narasimhan, "Micron-un 256GB SOCAMM2 təklifi, AI və HPC üçün ən enerji səmərəli CPU-yə bağlı yaddaş həllini təmin edir" deyə qeyd edib. Yeni LPDRAM modulu, müqayisəli RDIMMs-lərlə müqayisədə təxminən üçdə bir daha az enerji sərf edir və fiziki ölçüsü də daha kiçikdir.